diff options

| author | Amet Umerov <admin@amet13.name> | 2018-07-22 17:10:32 +0300 |

|---|---|---|

| committer | GitHub <noreply@github.com> | 2018-07-22 17:10:32 +0300 |

| commit | 4a018404be41059dcd6b4ebf4a3b20f7b9857a3e (patch) | |

| tree | 6caa47bdc1961b41fe6682aef1b4b2757f70e22d | |

| parent | 4702463662bfe1819d681658b511dce7f7cf72c6 (diff) | |

Использование линтера для маркдауна

| -rw-r--r-- | README.md | 553 |

1 files changed, 394 insertions, 159 deletions

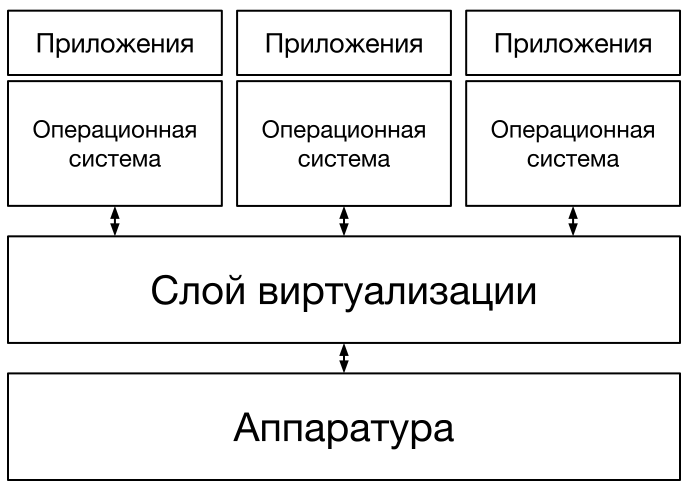

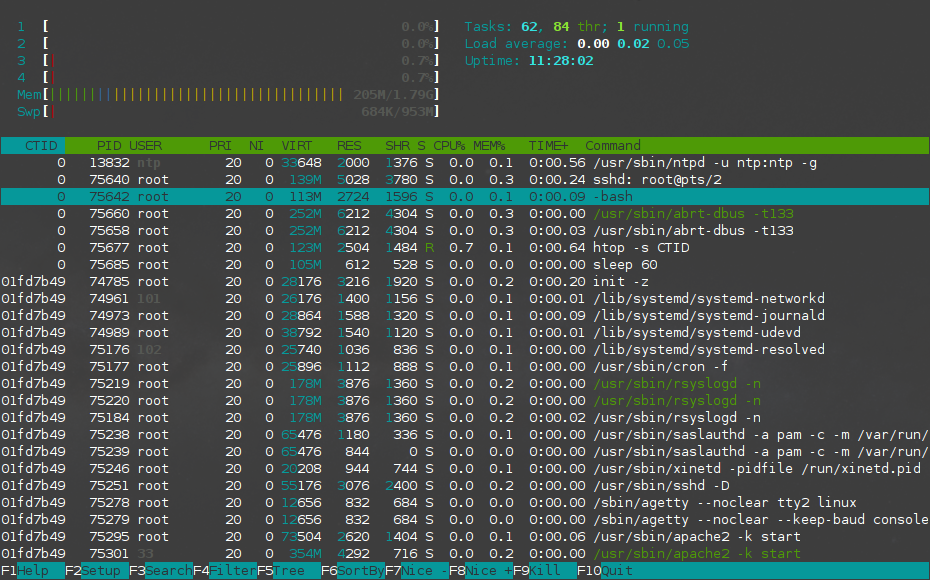

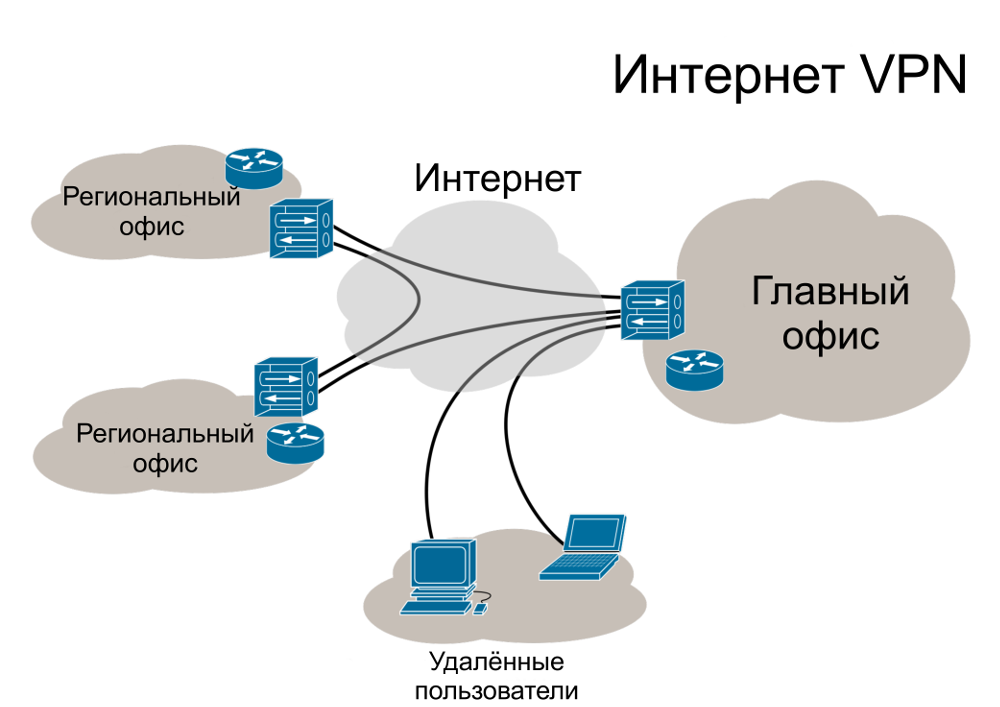

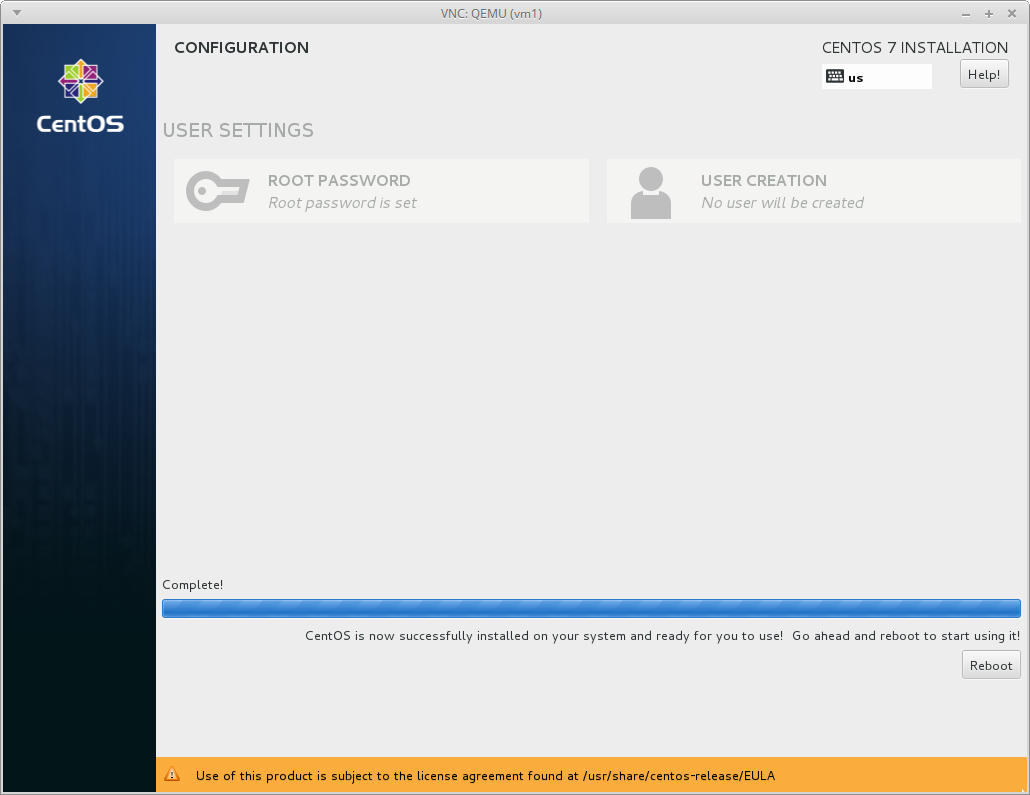

@@ -1,6 +1,7 @@ # Руководство по созданию и управлению контейнерами и виртуальными машинами на базе OpenVZ 7 ## <a name='toc'></a>Содержание + 1. [Введение в виртуализацию](#intro) - [Эмуляция оборудования](#emulation) - [Полная виртуализация](#full-virt) @@ -9,7 +10,7 @@ - [OpenVZ — объединение технологий виртуализации уровня ОС и полной виртуализации](#vz7) - [Сравнение производительности гипервизоров](#tests) 2. [Краткая история проектов Virtuozzo/OpenVZ](#history) -3. [Что нового в OpenVZ 7?](#changes) +3. [Что нового в OpenVZ 7](#changes) 4. [Установка и подготовительные действия](#install) - [Установка OpenVZ с помощью ISO-образа (bare-metal installation)](#bare-metal) - [Подготовительные действия](#prepare) @@ -59,30 +60,35 @@ 19. [Репозиторий проекта](#repo) ## [⬆](#toc) <a name='intro'></a>Введение в виртуализацию + Виртуализация — предоставление наборов вычислительных ресурсов или их логического объединения, абстрагированных от аппаратной реализации, и обеспечивающих изоляцию вычислительных процессов. Виртуализацию можно использовать в: -* консолидации серверов (возможность мигрировать с физических серверов на виртуальные, тем самым увеличивая коэффициент использования аппаратуры, что позволяет существенно сэкономить на аппаратуре, электроэнергии и обслуживании) -* разработке и тестировании приложений (возможность одновременно запускать несколько различных операционных систем (ОС), это удобно при разработке кроссплатформенного программного обеспечения (ПО), таким образом значительно повышается качество, скорость разработки и тестирования приложений) -* бизнесе (использование виртуализации в бизнесе растет с каждым днем и постоянно находятся новые способы применения этой технологии, например, возможность безболезненно сделать снапшот) -* организации виртуальных рабочих станций (так называемых "тонких клиентов") + +- консолидации серверов (возможность мигрировать с физических серверов на виртуальные, тем самым увеличивая коэффициент использования аппаратуры, что позволяет существенно сэкономить на аппаратуре, электроэнергии и обслуживании) +- разработке и тестировании приложений (возможность одновременно запускать несколько различных операционных систем (ОС), это удобно при разработке кроссплатформенного программного обеспечения (ПО), таким образом значительно повышается качество, скорость разработки и тестирования приложений) +- бизнесе (использование виртуализации в бизнесе растет с каждым днем и постоянно находятся новые способы применения этой технологии, например, возможность безболезненно сделать снапшот) +- организации виртуальных рабочих станций (так называемых "тонких клиентов") *Общая схема взаимодействия виртуализации с аппаратным и программным обеспечением*  Понятие виртуализации можно условно разделить на две категории: -* виртуализация платформ (продуктом этого вида виртуализации являются виртуальные машины) -* виртуализация ресурсов (преследует целью комбинирование или упрощение представления аппаратных ресурсов для пользователя и получение неких пользовательских абстракций оборудования, пространств имен, сетей) + +- виртуализация платформ (продуктом этого вида виртуализации являются виртуальные машины) +- виртуализация ресурсов (преследует целью комбинирование или упрощение представления аппаратных ресурсов для пользователя и получение неких пользовательских абстракций оборудования, пространств имен, сетей) Взаимодействие приложений и операционной системы с аппаратным обеспечением осуществляется через абстрагированный слой виртуализации. Существует несколько подходов организации виртуализации: -* эмуляция оборудования (QEMU, Bochs, Dynamips) -* полная виртуализация (KVM, Microsoft Hyper-V, Oracle VM VirtualBox, VMware ESXi) -* паравиртуализация (Xen, L4, Trango Virtual Processors) -* виртуализация уровня ОС (LXC, OpenVZ, FreeBSD jail, Solaris Zone) + +- эмуляция оборудования (QEMU, Bochs, Dynamips) +- полная виртуализация (KVM, Microsoft Hyper-V, Oracle VM VirtualBox, VMware ESXi) +- паравиртуализация (Xen, L4, Trango Virtual Processors) +- виртуализация уровня ОС (LXC, OpenVZ, FreeBSD jail, Solaris Zone) ### <a name='emulation'></a>Эмуляция оборудования + Эмуляция аппаратных средств является одним из самых сложных методов виртуализации. В то же время главной проблемой при эмуляции аппаратных средств является низкая скорость работы, в связи с тем, что каждая команда моделируется на основных аппаратных средствах. @@ -97,6 +103,7 @@ QEMU обеспечивает динамическую трансляцию пр Такой подход не только эффективен, но и обеспечивает переносимость. ### <a name='full-virt'></a>Полная виртуализация + Полная виртуализация использует гипервизор, который осуществляет связь между гостевой ОС и аппаратными средствами физического сервера. В связи с тем, что вся работа с гостевой операционной системой проходит через гипервизор, скорость работы данного типа виртуализации ниже чем в случае прямого взаимодействия с аппаратурой. Основным преимуществом полной виртуализации является то, что в ОС не вносится никаких изменений, единственное ограничение — операционная система должна поддерживать основные аппаратные средства (AMD SVM или Intel VT). @@ -109,6 +116,7 @@ QEMU обеспечивает динамическую трансляцию пр Эмуляцией устройств управляет модифицированная версия QEMU, которая обеспечивает эмуляцию BIOS, шины PCI, шины USB, а также стандартный набор устройств, таких как дисковые контроллеры IDE и SCSI, сетевые карты и другие. ### <a name='paravirt'></a>Паравиртуализация + Паравиртуализация имеет некоторые сходства с полной виртуализацией. Этот метод использует гипервизор для разделения доступа к основным аппаратным средствам, но объединяет код, касающийся виртуализации, в непосредственно операционную систему, поэтому недостатком метода является то, что гостевая ОС должна быть изменена для гипервизора. Но паравиртуализация существенно быстрее полной виртуализации, скорость работы виртуальной машины приближена к скорости реальной, это осуществляется за счет отсутствия эмуляции аппаратуры и учета существования гипервизора при выполнении системных вызовов в коде ядра. @@ -126,6 +134,7 @@ QEMU обеспечивает динамическую трансляцию пр Однако со временем поддержка аппаратной виртуализации в оборудовании получила настолько широкое распространение, что используется даже в современных процессорах лэптопов. ### <a name='cont-virt'></a>Контейнерная виртуализация (виртуализация уровня ОС) + Виртуализация уровня операционной системы отличается от других. Она использует технику, при которой серверы виртуализируются непосредственно над ОС. Недостатком метода является то, что поддерживается одна единственная операционная система на физическом сервере, которая изолирует контейнеры друг от друга. @@ -140,6 +149,7 @@ QEMU обеспечивает динамическую трансляцию пр Ядро обеспечивает полную изолированность контейнеров, поэтому программы из разных контейнеров не могут воздействовать друг на друга. ### <a name='vz7'></a>OpenVZ — объединение технологий виртуализации уровня ОС и полной виртуализации + OpenVZ позволяет создавать множество защищенных, изолированных друг от друга контейнеров на одном узле. Помимо этого существует возможность создания виртуальных машин на базе QEMU/KVM. Управление контейнерами и виртуальными машинами происходит с помощью специализированных утилит. @@ -151,17 +161,19 @@ OpenVZ позволяет создавать множество защищенн В отличие от KVM или Xen, OpenVZ использует одно ядро, которое является общим для всех виртуальных сред. Контейнеры можно разделить на две составляющие: -* ядро (namespaces, cgroups, CRIU, ploop, vcmmd...) -* пользовательские утилиты (prlctl, vzctl, vzpkg, vzlist...) + +- ядро (namespaces, cgroups, CRIU, ploop, vcmmd, ...) +- пользовательские утилиты (prlctl, vzctl, vzpkg, vzlist, ...) Namespaces — пространства имен. Это механизм ядра, который позволяет изолировать процессы друг от друга. Изоляция может быть выполнена в шести контекстах (пространствах имен): -* mount — предоставляет процессам собственную иерархию файловой системы и изолирует ее от других таких же иерархий по аналогии с chroot -* PID — изолирует идентификаторы процессов (PID) одного пространства имен от процессов с такими же идентификаторами другого пространства -* network — предоставляет отдельным процессам логически изолированный от других стек сетевых протоколов, сетевой интерфейс, IP-адрес, таблицу маршрутизации, ARP и прочие реквизиты -* IPC — обеспечивает разделяемую память и взаимодействие между процессами -* UTS — изоляция идентификаторов узла, таких как имя хоста (hostname) и домена (domain) -* user — позволяет иметь один и тот же набор пользователей и групп в рамках разных пространств имен, в каждом контейнере может быть свой root и любые другие пользователи и группы + +- mount — предоставляет процессам собственную иерархию файловой системы и изолирует ее от других таких же иерархий по аналогии с chroot +- PID — изолирует идентификаторы процессов (PID) одного пространства имен от процессов с такими же идентификаторами другого пространства +- network — предоставляет отдельным процессам логически изолированный от других стек сетевых протоколов, сетевой интерфейс, IP-адрес, таблицу маршрутизации, ARP и прочие реквизиты +- IPC — обеспечивает разделяемую память и взаимодействие между процессами +- UTS — изоляция идентификаторов узла, таких как имя хоста (hostname) и домена (domain) +- user — позволяет иметь один и тот же набор пользователей и групп в рамках разных пространств имен, в каждом контейнере может быть свой root и любые другие пользователи и группы CGroups (Control Groups) — позволяет ограничить аппаратные ресурсы некоторого набора процессов. Под аппаратными ресурсами подразумеваются: процессорное время, память, дисковая и сетевая подсистемы. @@ -193,6 +205,7 @@ VCMM (Virtuozzo containers memory management) — сервис управлен� На графике можно наблюдать, что OpenVZ обеспечивает практическую нативную пропускную способность 10Gb сети (9.7Gbit/s отправка и 9.87Gbit/s прием). ### <a name='tests'></a>Сравнение производительности гипервизоров + Тест используемый для оценки производительности называется DVD Store. Он использует классический набор серверного ПО: Linux, Apache, MySQL, PHP (LAMP). Внутри каждой ВМ эмулируется работа онлайн-магазина по продаже DVD. @@ -220,6 +233,7 @@ VCMM (Virtuozzo containers memory management) — сервис управлен� Количество CSU в тесте увеличивается последовательно от 1 до 24 (ось абсцисс). ## [⬆](#toc) <a name='history'></a>Краткая история проектов Virtuozzo/OpenVZ + В 1999 году возникла идея создания Linux-контейнеров, а уже в 2002 году компания SWsoft представила первый релиз коммерческой версии Virtuozzo. В том же 2002 году появились первые клиенты в Кремниевой долине. @@ -242,30 +256,34 @@ VCMM (Virtuozzo containers memory management) — сервис управлен� 25 июля 2016 года [анонсирован](https://lists.openvz.org/pipermail/announce/2016-July/000664.html) окончательный релиз продукта под именем OpenVZ 7.0. В релизе объявлены такие события как отказ от развития SimFS, также объявлено что со следующей версии OpenVZ утилита vzctl будет объявлена устаревшей, рекомендуется вместо нее использовать prlctl или virsh. -## [⬆](#toc) <a name='changes'></a>Что нового в OpenVZ 7? +## [⬆](#toc) <a name='changes'></a>Что нового в OpenVZ 7 + Основные изменения по сравнению с OpenVZ 6 (2.6.32): -* OpenVZ 7 базируется на ядре RHEL 7 (3.10) -* благодаря большой интеграции кода в ванильное ядро, количество патчей значительно сократилось, для сравнения число коммитов в 2.6.18 (RHEL 5) равно 264000, для 2.6.32 (RHEL 6) — 202000, для 3.10 (RHEL 7) — 66000 коммитов -* реализация живой миграции с помощью P.Haul и CRIU -* возможность создания виртуальных машин на базе KVM -* отказ от управления контейнерами с помощью vzctl в пользу prlctl и virsh -* использование механизма VCMM для управления памятью -* отказ от развития SimFS в пользу ploop -* унифицированное управление контейнерами и виртуальными машинами с помощью libvirt -* гарантированные лимиты памяти -* горячее подключение CPU/RAM для виртуальных машин, поддержка KSM -* обновленная документация с 2005 года -* интеграция работы с Docker и OpenStack + +- OpenVZ 7 базируется на ядре RHEL 7 (3.10) +- благодаря большой интеграции кода в ванильное ядро, количество патчей значительно сократилось, для сравнения число коммитов в 2.6.18 (RHEL 5) равно 264000, для 2.6.32 (RHEL 6) — 202000, для 3.10 (RHEL 7) — 66000 коммитов +- реализация живой миграции с помощью P.Haul и CRIU +- возможность создания виртуальных машин на базе KVM +- отказ от управления контейнерами с помощью vzctl в пользу prlctl и virsh +- использование механизма VCMM для управления памятью +- отказ от развития SimFS в пользу ploop +- унифицированное управление контейнерами и виртуальными машинами с помощью libvirt +- гарантированные лимиты памяти +- горячее подключение CPU/RAM для виртуальных машин, поддержка KSM +- обновленная документация с 2005 года +- интеграция работы с Docker и OpenStack ## [⬆](#toc) <a name='install'></a>Установка и подготовительные действия + Начиная с версии OpenVZ 7.0 доступен только один вариант установки, с помощью ISO-образа дистрибутива. Установка OpenVZ с помощью PXE (Preboot Execution Environment) подробно описана в [документации](https://docs.openvz.org/virtuozzo_7_installation_using_pxe_guide.webhelp/). ### <a name='bare-metal'></a>Установка OpenVZ с помощью ISO-образа (bare-metal installation) + Дистрибутив Virtuozzo Linux (VzLinux) с патчами для ядра RHEL 7, утилитами управления и модифицированным установщиком доступен для скачивания в виде стандартного ISO-образа и в виде netinstall-образа. -Текущие последние версии ISO-образов доступны по адресу: https://download.openvz.org/virtuozzo/releases/7.0/x86_64/iso/ +Текущие последние версии ISO-образов доступны по адресу: <https://download.openvz.org/virtuozzo/releases/7.0/x86_64/iso/> После записи дистрибутива на носитель, можно приступать к установке OpenVZ. Для этого необходимо загрузиться с носителя. @@ -306,6 +324,7 @@ VCMM (Virtuozzo containers memory management) — сервис управлен� Первый вход в систему осуществляется от пользователя `vzuser`, по SSH. Пример получения прав суперпользователя на сервере: + ``` user@localhost ~ $ ssh vzuser@192.168.0.150 vzuser@192.168.0.150's password: пароль_пользователя_vzuser @@ -315,8 +334,10 @@ Password: пароль_пользователя_root ``` ### <a name='prepare'></a>Подготовительные действия + На сервере важно всегда обновлять программное обеспечение, так как в новых версиях не только могут добавлять новые возможности, но и исправлять уязвимости. Указанная ниже команда обновляет все существующие в системе пакеты: + ``` [root@vz ~]# yum update ``` @@ -325,11 +346,13 @@ Password: пароль_пользователя_root Чтобы синхронизировать время с интернетом необходимо настроить сервер синхронизации времени ntp. Если во время установки ОС, была установлена некорректная временная зона, то можно это сделать позже: + ``` [root@vz ~]# timedatectl set-timezone Europe/Moscow ``` Установка `ntp` и синхронизация времени с удаленными серверами: + ``` [root@vz ~]# yum install ntp [root@vz ~]# systemctl start ntpd @@ -338,10 +361,13 @@ Password: пароль_пользователя_root ``` ## [⬆](#toc) <a name='templates'></a>Управление шаблонами + ### <a name='guest-os'></a>Шаблоны гостевых ОС + Шаблоны гостевых ОС используются для создания контейнеров. Просмотр списка уже имеющихся локальных шаблонов гостевых ОС: + ``` [root@vz ~]# vzpkg list -O --with-summary ubuntu-14.04-x86_64 :Ubuntu 14.04 (for AMD64/Intel EM64T) Virtuozzo Template @@ -354,6 +380,7 @@ debian-8.0-x86_64-minimal :Debian 8.0 minimal (for AMD64/Intel EM64T) V ``` Удаленно доступные шаблоны: + ``` [root@vz ~]# vzpkg list --available --with-summary debian-7.0-x86_64 @@ -367,16 +394,19 @@ vzlinux-6-x86_64 ``` Установка шаблона: + ``` [root@vz ~]# vzpkg install template ubuntu-16.04-x86_64 ``` Альтернативный вариант установки шаблона: + ``` [root@vz ~]# yum install ubuntu-16.04-x86_64-ez ``` Установка и обновление кэша шаблона: + ``` [root@vz ~]# vzpkg create cache ubuntu-16.04-x86_64 [root@vz ~]# vzpkg update cache ubuntu-16.04-x86_64 @@ -385,6 +415,7 @@ vzlinux-6-x86_64 Если не указывать имя шаблона, то установка или обновление кэша произойдет для всех имеющихся шаблонов. Просмотр даты последнего обновления кэша: + ``` [root@vz ~]# vzpkg list -O ubuntu-14.04-x86_64 @@ -397,10 +428,12 @@ debian-8.0-x86_64-minimal ``` ### <a name='app-templates'></a>Шаблоны приложений + Существует возможность установки шаблонов приложений для контейнеров. Основное отличие между шаблонами гостевых ОС и шаблонами приложений в том, что шаблоны гостевых ОС используются для создания контейнеров, а шаблоны приложений, обеспечивают установку дополнительного ПО для уже имеющихся контейнеров. Просмотр списка шаблонов приложений для `centos-7-x86_64`: + ``` [root@vz ~]# vzpkg list centos-7-x86_64 centos-7-x86_64 2016-02-09 17:01:05 @@ -420,6 +453,7 @@ centos-7-x86_64 jsdk ``` Пример установки шаблона приложений `tomcat` и `jre`: + ``` [root@vz ~]# vzpkg list ct5 centos-7-x86_64 2016-02-09 17:00:57 @@ -430,6 +464,7 @@ active ``` После установки можно проверить список установленных шаблонов для контейнера: + ``` [root@vz ~]# vzpkg list ct5 centos-7-x86_64 2016-02-09 17:00:57 @@ -438,6 +473,7 @@ centos-7-x86_64 jre 2016-02-09 20:03:50 ``` Удаление шаблона приложения из контейнера: + ``` [root@vz ~]# vzpkg remove ct5 tomcat Removed: @@ -453,6 +489,7 @@ centos-7-x86_64 jre 2016-02-09 20:03:50 ``` Создадим конфиг, на основе которого будет создаваться контейнер с CentOS 7 с предустановленным Apache Tomcat: + ``` [root@vz ~]# cd /etc/vz/conf/ [root@vz conf]# cp ve-basic.conf-sample ve-centos-7-x86_64-tomcat.conf-sample @@ -461,6 +498,7 @@ centos-7-x86_64 jre 2016-02-09 20:03:50 ``` Создадим кэш для этого приложения: + ``` [root@vz ~]# vzpkg create appcache --config centos-7-x86_64-tomcat [root@vz ~]# vzpkg list appcache @@ -469,6 +507,7 @@ centos-7-x86_64 2016-07-31 03:12:28 ``` На основе нового конфигурационного файла создадим и запустим контейнер: + ``` [root@vz ~]# prlctl create ct5 --config centos-7-x86_64-tomcat --vmtype=ct Creating the Virtuozzo Container... @@ -479,15 +518,18 @@ The CT has been successfully started. ``` Проверка предустановки Apache Tomcat в составе шаблона: + ``` [root@vz ~]# prlctl exec ct5 rpm -q tomcat tomcat-7.0.54-2.el7_1.noarch ``` ### <a name='templates-сt-vm'></a>Шаблоны контейнеров и виртуальных машин + Помимо шаблонов гостевых ОС и шаблонов приложений, существует также возможность создания контейнера или виртуальной машины на основе других контейнеров или ВМ. Пример создания шаблона на основе контейнера `ct2` с установленным веб-сервером nginx: + ``` [root@vz ~]# prlctl clone ct2 --name CentOS7+nginx --template Clone the ct2 CT to template CentOS7+nginx... @@ -495,6 +537,7 @@ The CT has been successfully cloned. ``` Просмотр списка доступных шаблонов: + ``` [root@vz ~]# prlctl list -t UUID DIST T NAME @@ -502,6 +545,7 @@ UUID DIST T NAME ``` Создадим новый контейнер на основе шаблона `CentOS7+nginx`: + ``` [root@vz ~]# prlctl create ct3 --ostemplate CentOS7+nginx Creating the VM on the basis of the CentOS7+nginx template... @@ -510,6 +554,7 @@ The CT has been successfully cloned. ``` Удаление шаблона: + ``` [root@vz ~]# prlctl delete CentOS7+nginx Removing the CT... @@ -517,7 +562,9 @@ The CT has been successfully removed. ``` ## [⬆](#toc) <a name='ct'></a>Создание и настройка контейнеров + ### <a name='configs'></a>Конфигурационные файлы + В старых версиях OpenVZ основным идентификатором контейнера является CTID, который вручную указывался при создании контейнера. Сейчас в этом нет необходимости, на смену CTID пришел UUID, который создается автоматически. @@ -530,6 +577,7 @@ The CT has been successfully removed. При создании контейнера можно использовать типовую конфигурацию. Типовые файлы конфигураций находятся в каталоге `/etc/vz/conf/`: + ``` [root@vz ~]# ls /etc/vz/conf/ | grep sample ve-basic.conf-sample @@ -544,6 +592,7 @@ vps.vzpkgtools.conf-sample В этих конфигурационных файлах описаны контрольные параметры ресурсов, выделенное дисковое пространство, оперативная память и т.д. Например, при использовании конфига `ve-vswap.512MB.conf-sample`, создается контейнер с дисковым пространством 10GB, оперативной памятью 512MB и swap 512MB: + ``` [root@vz ~]# egrep "DISKSPACE|PHYSPAGES|SWAPPAGES|DISKINODES" /etc/vz/conf/ve-vswap.512MB.conf-sample PHYSPAGES="131072:131072" @@ -555,6 +604,7 @@ DISKINODES="655360:655360" Это удобно, так как существует возможность создавать свои конфигурационные файлы для различных вариаций контейнеров. Создадим свой конфигурационный файл, на базе уже существующего `vswap.512MB`. Исправим в нем только значения `PHYSPAGES`, `SWAPPAGES`, `DISKSPACE`, `DISKINODES`: + ``` [root@vz ~]# cp /etc/vz/conf/ve-vswap.512MB.conf-sample /etc/vz/conf/ve-vswap.1GB.conf-sample [root@vz ~]# vim /etc/vz/conf/ve-vswap.1GB.conf-sample @@ -563,16 +613,20 @@ SWAPPAGES="262144" DISKSPACE="20971520:20971520" DISKINODES="1310720:1310720" ``` + Таким образом, при использовании этого конфигурационного файла, будет создаваться контейнер, которому будет доступно 20GB выделенного дискового пространства, 1GB оперативной памяти и 1GB swap. Установка конфигурационного файла шаблона на примере `vswap.1GB` (контейнер должен быть создан): + ``` [root@vz ~]# prlctl set ct1 --applyconfig vswap.1GB The CT has been successfully configured. ``` ### <a name='create-ct'></a>Создание контейнера + В качестве параметра к идентификатору контейнера может использоваться любое имя: + ``` [root@vz ~]# prlctl create ct1 --ostemplate debian-8.0-x86_64 --vmtype=ct Creating the Virtuozzo Container... @@ -582,6 +636,7 @@ The Container has been successfully created. Таким образом был создан контейнер с именем `ct1` на базе шаблона `debian-8.0-x86_64`. Теперь можно просмотреть список имеющихся в системе контейнеров: + ``` [root@vz ~]# prlctl list -a UUID STATUS IP_ADDR T NAME @@ -591,6 +646,7 @@ UUID STATUS IP_ADDR T NAME Если же при создании контейнера не указывать желаемый шаблон, то OpenVZ будет использовать шаблон по умолчанию. Конфигурационный файл, в котором указаны директивы по умолчанию `/etc/vz/vz.conf`. По умолчанию, используется шаблон `centos-7` и конфигурационный файл `basic`: + ``` [root@vz ~]# egrep "CONFIGFILE|DEF_OSTEMPLATE" /etc/vz/vz.conf CONFIGFILE="basic" @@ -600,38 +656,45 @@ DEF_OSTEMPLATE=".centos-7" Если планируется создание большого количества однотипных контейнеров, основываясь на одном и том же конфиге, то значения можно исправить на нужные. ### <a name='setup-ct'></a>Настройка контейнера + Контейнер создан, его можно запускать. Но перед первым запуском необходимо установить его IP-адреса, hostname, указать DNS сервера и задать пароль суперпользователя. Добавление IP-адресов: + ``` [root@vz ~]# prlctl set ct1 --ipadd 192.168.0.161/24 [root@vz ~]# prlctl set ct1 --ipadd fe80::20c:29ff:fe01:fb08 ``` Установка DNS серверов и hostname: + ``` [root@vz ~]# prlctl set ct1 --nameserver 192.168.0.1,192.168.0.2 [root@vz ~]# prlctl set ct1 --hostname ct1.vz.localhost ``` Установка поискового домена: + ``` [root@vz ~]# prlctl set ct1 --searchdomain vz.localhost ``` Установка пароля суперпользователя: + ``` [root@vz ~]# prlctl set ct1 --userpasswd root:eVjfsDkTE63s5Nw ``` Сгенерировать пароль можно штатными средствами Linux: + ``` [root@vz ~]# cat /dev/urandom | tr -dc 'a-zA-Z0-9' | fold -w 15 | head -1 BC4Ce984DBWVcXc ``` Или воспользоваться утилитой `pwgen`: + ``` [root@vz ~]# yum localinstall https://dl.fedoraproject.org/pub/epel/7/x86_64/p/pwgen-2.07-1.el7.x86_64.rpm [root@vz ~]# pwgen -s 15 1 @@ -642,17 +705,21 @@ esxrcH7dyoA46LY Если же пароль будет утерян или забыт, то можно будет просто задать новый. Для запуска контейнера при старте хост-ноды добавляем: + ``` [root@vz ~]# prlctl set ct1 --onboot yes ``` Также можно добавить краткое описание контейнера: + ``` [root@vz ~]# prlctl set ct1 --description "This is my first container" ``` ### <a name='run-enter'></a>Запуск и вход + Запуск контейнера: + ``` [root@vz ~]# prlctl start ct1 Starting the CT... @@ -660,6 +727,7 @@ The CT has been successfully started. ``` Проверка сетевых интерфейсов внутри гостевой ОС: + ``` [root@vz ~]# prlctl exec ct1 ip addr show venet0 2: venet0: <BROADCAST,POINTOPOINT,NOARP,UP,LOWER_UP> mtu 1500 qdisc noqueue state UNKNOWN group default @@ -675,12 +743,14 @@ The CT has been successfully started. ``` Проверка корректности hostname: + ``` [root@vz ~]# prlctl exec ct1 hostname ct1.vz.localhost ``` Проверка доступности контейнера в сети и корректность пароля суперпользователя: + ``` [root@vz ~]# ssh root@192.168.0.161 root@192.168.0.161's password: eVjfsDkTE63s5Nw @@ -688,6 +758,7 @@ root@ct1:~# ``` Вход в контейнер напрямую с хост-ноды: + ``` [root@vz ~]# prlctl enter ct1 entered into CT @@ -697,6 +768,7 @@ logout ``` Переход в консоль контейнера: + ``` [root@vz ~]# prlctl console ct2 Attached to CT 9d921e42-1087-45e6-bea0-3d706b2d1862 tty2 (type ESC . to detach) @@ -712,8 +784,11 @@ Password: veig7Ei1iedeVa8 Для выхода из консоли необходимо использовать комбинацию клавиш `ESC` + `.` ## [⬆](#toc) <a name='management-ct'></a>Управление контейнерами + ### <a name='status-ct'></a>Управление состоянием контейнера + Статус контейнера: + ``` [root@vz ~]# prlctl status ct1 CT ct1 exist running @@ -724,6 +799,7 @@ CT ct2 exist stopped По выводу команды можно увидеть, что контейнер `ct1` запущен, а контейнер `ct2` остановлен. Остановка контейнера: + ``` [root@vz ~]# prlctl stop ct1 Stopping the CT... @@ -732,6 +808,7 @@ The CT has been successfully stopped. Иногда нужно выключить контейнер как можно быстрее, например если он был подвержен взлому или создает критическую нагрузку на хост-ноду. Для того чтобы срочно выключить контейнер, нужно использовать ключ `--kill`: + ``` [root@vz ~]# prlctl stop ct1 --kill Stopping the CT... @@ -739,6 +816,7 @@ The CT has been forcibly stopped ``` Перезапуск контейнера: + ``` [root@vz ~]# prlctl restart ct1 Restarting the CT... @@ -748,6 +826,7 @@ The CT has been successfully restarted. Приостановка контейнера сохраняет текущее состояние контейнера в файл, позволяя восстановить контейнер в то же состояние, в котором он был приостановлен, это может быть полезно, к примеру если перезагружается хост-нода и нужно сохранить состояние процессов в контейнере. Параметр `suspend` приостанавливает контейнер, а `resume` — восстанавливает: + ``` [root@vz ~]# prlctl suspend ct1 Suspending the CT... @@ -760,6 +839,7 @@ The CT has been successfully resumed. ``` Для удаления контейнера существует параметр `delete` (перед удалением, контейнер нужно сначала остановить): + ``` [root@vz ~]# prlctl stop ct1 [root@vz ~]# prlctl delete ct1 @@ -771,6 +851,7 @@ The CT has been successfully removed. Для того чтобы смонтировать содержимое контейнера без его запуска существует опция `mount`, для размонтирования — `umount`. Это может пригодиться например для того, чтобы поправить конфигурационные файлы контейнера с хост-ноды, если контейнер не стартует: + ``` [root@vz ~]# prlctl mount ct6 Mounting the CT... @@ -787,6 +868,7 @@ The CT has been successfully unmounted. ``` Переместить частную область контейнера в другую область можно с помощью параметра `move`: + ``` [root@vz ~]# mkdir /home/private [root@vz ~]# prlctl move ct6 --dst /home/private @@ -797,6 +879,7 @@ dump/ fs/ .lck .owner root.hdd/ scripts/ template ``` Сброс аптайма (времени создания и работы) контейнера: + ``` [root@vz ~]# prlctl list -i ct1 | grep Uptime Uptime: 01:15:57 (since 2016-07-31 01:18:41) @@ -808,9 +891,11 @@ Uptime: 00:00:00 (since 2016-08-17 23:18:22) ``` ### <a name='reinstall-ct'></a>Переустановка контейнера + Для переустановки ОС в контейнере, существует команда `vzctl reinstall`. Переустановка и старт контейнера (для переустановки нужно сначала остановить контейнер): + ``` [root@vz ~]# prlctl stop ct1 [root@vz ~]# vzctl reinstall ct1 --skipbackup @@ -823,7 +908,9 @@ Container was successfully reinstalled Для того, чтобы не копировать частную область предыдущего контейнера, необходимо использовать ключ `--skipbackup`. ### <a name='clone-ct'></a>Клонирование контейнера + OpenVZ позволяет клонировать контейнеры: + ``` [root@vz ~]# prlctl clone ct1 --name ct2 Clone the ct1 CT to CT ct2... @@ -835,6 +922,7 @@ UUID STATUS IP_ADDR T NAME ``` При клонировании контейнера необходимо помнить о смене IP-адреса, иначе при попытке запуска будет наблюдаться ошибка: + ``` [root@vz ~]# prlctl start ct2 Starting the CT... @@ -844,29 +932,35 @@ Failed to start the Container ``` Сначала нужно удалить старые IP-адреса: + ``` [root@vz ~]# prlctl set ct2 --ipdel 192.168.0.161/24 [root@vz ~]# prlctl set ct2 --ipdel fe80::20c:29ff:fe01:fb08 ``` Затем добавить новые: + ``` [root@vz ~]# prlctl set ct2 --ipadd 192.168.0.162/24 [root@vz ~]# prlctl set ct2 --ipadd fe80::20c:29ff:fe01:fb09 ``` Смена hostname: + ``` [root@vz ~]# prlctl set ct2 --hostname ct2.vz.localhost ``` После этого контейнер можно запустить: + ``` [root@vz ~]# prlctl start ct2 ``` ### <a name='run-commands'></a>Запуск команд в контейнере с хост-ноды + Пример запуска команды в контейнере: + ``` [root@vz ~]# prlctl exec ct1 cat /etc/issue Debian GNU/Linux 8 \n \l @@ -874,6 +968,7 @@ Debian GNU/Linux 8 \n \l Иногда бывает нужно выполнить команду на нескольких контейнерах. Для этого можно использовать конструкцию: + ``` [root@vz ~]# CMD="cat /etc/issue" [root@vz ~]# for i in `prlctl list -o name -H`; do echo "CT $i"; prlctl exec $i $CMD; done @@ -885,53 +980,64 @@ Debian GNU/Linux 8 \n \l ``` ## [⬆](#toc) <a name='resources-ct'></a>Управление ресурсами контейнеров + Доступные контейнеру ресурсы контролируются с помощью набора параметров управления ресурсами. Все эти параметры можно редактировать в файлах шаблонов, в каталоге `/etc/vz/conf/`. Их можно установить вручную, редактируя соответствующие конфиги или используя утилиты OpenVZ. Параметры контроля ресурсов контейнеров условно разделяют на группы: -* дисковые квоты -* процессор -* операции ввода/вывода -* память -* сеть + +- дисковые квоты +- процессор +- операции ввода/вывода +- память +- сеть ### <a name='quota'></a>Дисковые квоты + Администратор сервера OpenVZ может устанавливать дисковые квоты, в терминах дискового пространства и количества inodes, число которых примерно равно количеству файлов. Это первый уровень дисковой квоты. В дополнение к этому, администратор может использовать обычные утилиты внутри окружения, для настроек стандартных дисковых квот UNIX для пользователей и групп. Для использования дисковых квот, соответствующая директива должна присутствовать в конфигурационном файле OpenVZ: + ``` [root@vz ~]# grep DISK_QUOTA /etc/vz/vz.conf DISK_QUOTA=yes ``` Основные параметры: -* `DISKSPACE` — общий размер дискового пространства (задается в Kb) -* `DISKINODES` — общее число дисковых inodes -* `QUOTATIME` — время (в секундах) на которое контейнер может превысить значение soft предела + +- `DISKSPACE` — общий размер дискового пространства (задается в Kb) +- `DISKINODES` — общее число дисковых inodes +- `QUOTATIME` — время (в секундах) на которое контейнер может превысить значение soft предела Параметры записываются в конфигурационный файл в виде: + ``` COMMAND="softlimit:hardlimit" ``` + где: -* `COMMAND` — команда (`DISKSPACE` или `DISKINODES`) -* `softlimit` — значение которое превышать нежелательно, после пересечения этого предела наступает grace период, по истечении которого, дисковое пространство или inodes прекратят свое существование -* `hardlimit` — значение которое превысить нельзя + +- `COMMAND` — команда (`DISKSPACE` или `DISKINODES`) +- `softlimit` — значение которое превышать нежелательно, после пересечения этого предела наступает grace период, по истечении которого, дисковое пространство или inodes прекратят свое существование +- `hardlimit` — значение которое превысить нельзя Например, запись: + ``` DISKSPACE="19922944:20971520" DISKINODES="1300000:1310720" QUOTATIME="600" ``` + означает, что задается `softlimit` для дискового пространства равным ~19G и `hardlimit` равный 20G, то же самое с inodes 1300000 и 1310720 соответственно. Если размер занятого дискового пространства или inodes будет выше `softlimit`, то в течении 600 сек (10 мин), в случае не освобождения дискового пространства или inodes, они прекратят свое существование. Аналогично, можно установить эти параметры с помощью `vzctl`: + ``` [root@vz ~]# vzctl set ct1 --diskspace 5G:6G --save Resize the image /vz/private/3d32522a-80af-4773-b9fa-ea4915dee4b3/root.hdd to 6291456K @@ -940,20 +1046,23 @@ dumpe2fs 1.42.9 (28-Dec-2013) ``` ### <a name='cpu'></a>Процессор + Планировщик процессора в OpenVZ также двухуровневый. На первом уровне планировщик решает, какому контейнеру дать квант процессорного времени, базируясь на значении параметра `CPUUNITS` для контейнера. На втором уровне стандартный планировщик GNU/Linux решает, какому процессу в выбранном контейнере дать квант времени, базируясь на стандартных приоритетах процесса. Основными параметрами управления CPU являются: -* `CPUUNITS` — гарантируемое минимальное количество времени процессора, которое получит соответствующий контейнер -* `CPUMASK` — привязка контейнера к конкретным процессорам, по умолчанию нагрузка распределяется на все процессоры -* `CPULIMIT` — верхний лимит процессорного времени в процентах -* `CPUS` — количество используемых процессорных ядер контейнером -* `NODEMASK` — привязка ядер NUMA-систем к контейнеру + +- `CPUUNITS` — гарантируемое минимальное количество времени процессора, которое получит соответствующий контейнер +- `CPUMASK` — привязка контейнера к конкретным процессорам, по умолчанию нагрузка распределяется на все процессоры +- `CPULIMIT` — верхний лимит процессорного времени в процентах +- `CPUS` — количество используемых процессорных ядер контейнером +- `NODEMASK` — привязка ядер NUMA-систем к контейнеру Параметр `CPUUNITS` указывает процессорное время доступное для контейнера. По умолчанию для каждого контейнера это значение равно 1000. То есть, если для контейнера `ct1` установить значение 2000, а для контейнера `ct2` оставить значение 1000, то при равных условиях контейнер `ct1` получит ровно в два раза больше процессорного времени. + ``` [root@vz ~]# prlctl set ct1 --cpuunits 2000 set cpuunits 2000 @@ -961,19 +1070,23 @@ set cpuunits 2000 Если система многопроцессорная, то установка параметра `CPUMASK` может пригодиться для привязки контейнера к конкретным процессорам. В случае восьмипроцессорной системы можно, к примеру, привязать контейнер к процессорам 0-3, 6, 7: + ``` [root@vz ~]# prlctl set ct1 --cpumask 0-3,6,7 set cpu mask 0-3,6,7 ``` Параметр `CPULIMIT` указывает общий верхний лимит процессорного времени для всех ядер процессора: + ``` [root@vz ~]# prlctl set ct1 --cpulimit 15 set cpulimit 15% ``` + Для одноядерного процессора верхний лимит будет равен 100%, для двухядерного 200% и так далее. Существует также возможность задания `CPULIMIT` в абсолютных значениях (MHz): + ``` [root@vz ~]# prlctl set ct1 --cpulimit 600m set cpulimit 600Mhz @@ -981,25 +1094,28 @@ set cpulimit 600Mhz В параметре `CPUS` задается число доступных для контейнера процессорных ядер. Контейнер по умолчанию получает в использование все процессорные ядра: + ``` [root@vz ~]# CPUINFO="grep processor /proc/cpuinfo" [root@vz ~]# prlctl exec ct1 $CPUINFO -processor : 0 -processor : 1 -processor : 2 -processor : 3 +processor : 0 +processor : 1 +processor : 2 +processor : 3 ``` Установим для контейнера лимит в 2 процессорных ядра: + ``` [root@vz ~]# prlctl set ct1 --cpus 2 set cpus(4): 2 [root@vz ~]# prlctl exec ct1 $CPUINFO -processor : 0 -processor : 1 +processor : 0 +processor : 1 ``` Для систем архитектуры NUMA существует возможность привязки контейнера к процессорам NUMA-нод: + ``` [root@vz ~]# prlctl set ct1 --nodemask 0 ``` @@ -1008,16 +1124,19 @@ processor : 1 При этом контейнер может потреблять больше времени, чем определено этой величиной, если нет другого конкурирующего с ним за время CPU сервера. ### <a name='io'></a>Операции ввода/вывода + В OpenVZ существует возможность управления дисковыми операциями ввода/вывода. Можно устанавливать значения таких параметров как: -* `IOPRIO` -* `IOLIMIT` -* `IOPSLIMIT` + +- `IOPRIO` +- `IOLIMIT` +- `IOPSLIMIT` Параметр `IOPRIO` указывает приоритет операция ввода вывода для контейнера. По умолчанию для всех контейнеров установлен равный приоритет (значение 4). Изменение значения параметра можно регулировать от 0 (максимальный приоритет) до 7: + ``` [root@vz ~]# prlctl set ct1 --ioprio 6 set ioprio 6 @@ -1027,22 +1146,25 @@ set ioprio 6 По умолчанию параметр имеет значение 0, то есть отсутствие лимитов. Установка значения в MB/s: + ``` [root@vz ~]# prlctl set ct1 --iolimit 20 Set up iolimit: 20971520 ``` Существует возможность указания префиксов метрических значений: -* `G` — гигабайт -* `M` — мегабайт -* `K` — килобайт -* `B` — байт + +- `G` — гигабайт +- `M` — мегабайт +- `K` — килобайт +- `B` — байт Максимальная пропускная способность дисковых операций ввода/вывода составляет 2GB/s. Помимо ограничения пропускной способности операций ввода/вывода, существует возможность ограничения количества операций ввода/вывода в секунду. Параметр `IOPSLIMT` позволяет установить численное значение операций ввода/вывода в секунду, например 300: + ``` [root@vz ~]# prlctl set ct1 --iopslimit 300 set IOPS limit 300 @@ -1053,6 +1175,7 @@ set IOPS limit 300 Проверка ограничения пропускной способностей операций ввода/вывода на примере `IOLIMIT`. Значение `IOLIMIT` равно 0: + ``` root@ct1:/# dd if=/dev/zero of=test bs=1048576 count=10 10+0 records in @@ -1061,6 +1184,7 @@ root@ct1:/# dd if=/dev/zero of=test bs=1048576 count=10 ``` Значение `IOLIMIT` равно 500K: + ``` root@ct1:/# dd if=/dev/zero of=test bs=1048576 count=10 10+0 records in @@ -1069,23 +1193,28 @@ root@ct1:/# dd if=/dev/zero of=test bs=1048576 count=10 ``` ### <a name='memory'></a>Память + В OpenVZ используется управление памятью четвертого поколения с помощью VCMM. В прошлом же использовалось управление памятью с помощью: -* VSwap (третье поколение) -* SLM (второе поколение) -* User Beancounters (первое поколение) + +- VSwap (третье поколение) +- SLM (второе поколение) +- User Beancounters (первое поколение) С пользовательской стороны управление памятью с помощью VSwap и VCMM ничем не отличаются, однако с точки зрения реализации, VCMM уже находится в ванильном ядре и не требует патчей со стороны разработчиков OpenVZ. Ограничения физической памяти и swap задаются в конфигурационном файле контейнера параметрами `PHYSPAGES` и `SWAPPAGES`. Значения устанавливаются в блоках, например: + ``` PHYSPAGES="262144:262144" SWAPPAGES="262144:262144" ``` + равняются значениям в 1024MB (262144 блок / 256 = 1024MB). С помощью `prlctl` значения параметров можно указывать в метрической системе: + ``` [root@vz ~]# prlctl set ct1 --memsize 1G --swappages 1G Set the memsize parameter to 1024Mb. @@ -1099,11 +1228,13 @@ Overcommiting — возможность использования больше То есть для контейнера установлено, с 1024MB оперативной памяти и 1024MB swap, суммарно доступно 2048MB памяти, в случае необходимости контейнер сможет использовать (2048MB * 1.5 = 3072MB) памяти. Для изменения значения достаточно прописать параметр в конфигурационный файл контейнера и перезапустить его: + ``` VM_OVERCOMMIT="2" ``` Также возможна установка параметра с помощью `vzctl`: + ``` [root@vz ~]# vzctl set ct1 --vm_overcommit 2 --save ``` @@ -1112,7 +1243,9 @@ VM_OVERCOMMIT="2" Естественно, если если эти ресурсы доступны на хост-ноде. ### <a name='monitoring'></a>Мониторинг ресурсов + С помощью утилиты `vznetstat` можно увидеть входящий и исходящий трафик (в байтах и пакетах) для всех контейнеров: + ``` [root@vz ~]# vznetstat UUID Net.Class Input(bytes) Input(pkts) Output(bytes) Output(pkts) @@ -1123,6 +1256,7 @@ UUID Net.Class Input(bytes) Input(pkts) Outpu ``` Для конкретного контейнера можно воспользоваться ключом `-v`: + ``` [root@vz ~]# vznetstat -v 3d32522a-80af-4773-b9fa-ea4915dee4b3 UUID Net.Class Input(bytes) Input(pkts) Output(bytes) Output(pkts) @@ -1130,6 +1264,7 @@ UUID Net.Class Input(bytes) Input(pkts) Ou ``` Утилита `vzstat` позволяет узнать информацию по нагрузке на контейнер, занятым ресурсам и состоянии сети: + ``` [root@vz ~]# vzstat -p 3d32522a-80af-4773-b9fa-ea4915dee4b3 -t loadavg 0 0 0 @@ -1156,6 +1291,7 @@ Disks stats 0.000 0.000 ``` `vzpid` позволяет узнать к какому контейнеру принадлежит процесс, это может быть полезно при просмотре списка процессов с хост-ноды и поиска "процесса-грузчика": + ``` [root@vz ~]# top ... @@ -1168,6 +1304,7 @@ Disks stats 0.000 0.000 ``` Утилита `vzps` аналогична утилите `ps`, она позволяет вывести список процессов и их состояние для конкретного контейнера: + ``` [root@vz ~]# vzps aufx -E 3d32522a-80af-4773-b9fa-ea4915dee4b3 USER PID %CPU %MEM VSZ RSS TTY STAT START TIME COMMAND @@ -1194,17 +1331,20 @@ Disks stats 0.000 0.000 ``` Утилита `vztop` теперь заменена алиасом на `htop` с отображением UUID контейнера, которому принадлежит процесс: + ``` [root@vz ~]# which vztop alias vztop='htop -s CTID' - /usr/bin/htop +/usr/bin/htop ``` *Утилита vztop*  ## [⬆](#toc) <a name='forward-dev-ct'></a>Проброс устройств в контейнеры + ### <a name='tun-tap'></a>TUN/TAP + Технология VPN позволяет устанавливать безопасное сетевое соединение между компьютерами. Для того чтобы VPN работала в контейнере, необходимо разрешить использование TUN/TAP устройств для контейнера. @@ -1212,17 +1352,20 @@ alias vztop='htop -s CTID'  По умолчанию модуль TUN уже загружен в ядро, проверить это можно командой `lsmod`: + ``` [root@vz ~]# lsmod | grep ^tun tun 27183 1 ``` Если все-таки модуль отключен, то включить его можно командой `modprobe`: + ``` [root@vz ~]# modprobe tun ``` Проброс модуля TUN в контейнер: + ``` [root@vz ~]# vzctl set ct3 --devnodes net/tun:rw --save Setting devices @@ -1234,14 +1377,17 @@ crw------- 1 root root 10, 200 Feb 10 13:12 /dev/net/tun На этом настройка TUN окончена. Далее необходимо установить ПО для работы с VPN. Например одну из программ: -* [OpenVPN](https://openvpn.net) -* [tinc](https://tinc-vpn.org) + +- [OpenVPN](https://openvpn.net) +- [tinc](https://tinc-vpn.org) ### <a name='fuse'></a>FUSE + FUSE (Filesystem in Userspace) — модуль ядра Linux, позволяющий создавать виртуальные файловые системы. FUSE может пригодиться, например при монтировании Яндекс.Диска или других виртуальных файловых систем. Для того, чтобы для контейнеров был доступен FUSE, его необходимо включить на хост-ноде: + ``` [root@vz ~]# modprobe fuse [root@vz ~]# lsmod | grep fuse @@ -1249,11 +1395,13 @@ fuse 106371 0 ``` Также необходимо добавить модуль в автозагрузку, чтобы он подгружался автоматически при рестарте хост-ноды: + ``` [root@vz ~]# echo fuse >> /etc/modules-load.d/vz.conf ``` Включение FUSE для контейнера: + ``` [root@vz ~]# vzctl set ct3 --devnodes fuse:rw --save Setting devices @@ -1263,6 +1411,7 @@ crw------- 1 root root 10, 229 Feb 10 13:42 /dev/fuse ``` Пример подключения Яндекс.Диска в контейнере: + ``` [root@vz ~]# prlctl exec ct3 yum install fuse davfs2 [root@vz ~]# prlctl exec ct3 mount -t davfs https://webdav.yandex.ru /mnt/ @@ -1275,10 +1424,12 @@ https://webdav.yandex.ru or hit enter for none. ``` ### <a name='nfs'></a>NFS + NFS (Network File System) – это сетевая файловая система, позволяющая пользователям обращаться к файлам и каталогам, расположенным на удаленных компьютерах, как если бы эти файлы и каталоги были локальными. По умолчанию модуль ядра NFS уже включен в OpenVZ, поэтому нужно всего лишь пробросить устройство в контейнер. Перед пробросом модуля контейнер нужно остановить: + ``` [root@vz ~]# prlctl stop ct1 [root@vz ~]# prlctl set ct1 --features nfsd:on @@ -1286,6 +1437,7 @@ set features: nfsd:on ``` А после – включить и проверить работоспособность сервиса `nfs`: + ``` [root@vz ~]# prlctl start ct1 [root@vz ~]# prlctl exec ct1 systemctl start nfs @@ -1294,12 +1446,14 @@ active ``` ### <a name='pptp'></a>PPTP + PPTP (Point-to-Point Tunneling Protocol) — туннельный протокол типа точка-точка, позволяющий компьютеру устанавливать защищенное соединение с сервером за счет создания специального туннеля в стандартной, незащищенной сети. PPTP может также использоваться для организации туннеля между двумя локальными сетями. Для работы PPTP в контейнере OpenVZ нужно включить соответствующие модули ядра на хост-ноде. Добавление модулей ядра `ppp_async`, `ppp_deflate`, `ppp_mppe`: + ``` [root@vz ~]# modprobe ppp_async [root@vz ~]# modprobe ppp_deflate @@ -1315,6 +1469,7 @@ crc_ccitt 12707 1 ppp_async ``` Добавление модулей в автозагрузку: + ``` [root@vz ~]# echo ppp_async >> /etc/modules-load.d/vz.conf [root@vz ~]# echo ppp_deflate >> /etc/modules-load.d/vz.conf @@ -1322,6 +1477,7 @@ crc_ccitt 12707 1 ppp_async ``` Остановка контейнера, проброс устройства и запуск контейнера: + ``` [root@vz ~]# prlctl stop ct1 [root@vz ~]# vzctl set ct1 --devnodes ppp:rw --save @@ -1329,6 +1485,7 @@ crc_ccitt 12707 1 ppp_async ``` Проверка работы сервиса: + ``` [root@vz ~]# prlctl enter ct1 [root@ct1 ~]# ls /dev/ppp @@ -1338,19 +1495,22 @@ crc_ccitt 12707 1 ppp_async ``` ### <a name='netfilter'></a>Netfilter/IPTables + Netfilter — это межсетевой экран в ядре Linux. В OpenVZ существует возможность включать или отключать Netfilter для контейнера. Доступно четыре режима работы Netfilter в контейнере: -* disabled — отключены все модули -* stateless (по умолчанию) — все модули включены, за исключением NAT и conntracks -* stateful — все модули включены, за исключением NAT -* full — все модули включены + +- disabled — отключены все модули +- stateless (по умолчанию) — все модули включены, за исключением NAT и conntracks +- stateful — все модули включены, за исключением NAT +- full — все модули включены Для изменения параметров Netfilter, контейнер должен быть отключен. Пример отключения всех модулей Netfilter для контейнера: + ``` [root@vz ~]# prlctl stop ct1 [root@vz ~]# prlctl set ct1 --netfilter disabled @@ -1362,6 +1522,7 @@ Perhaps iptables or your kernel needs to be upgraded. ``` Включение всех модулей: + ``` [root@vz ~]# prlctl stop ct1 [root@vz ~]# prlctl set ct1 --netfilter full @@ -1378,22 +1539,26 @@ REJECT all -- anywhere anywhere reject-with icmp-h ``` ## [⬆](#toc) <a name='simfs-ploop'></a>SimFS и ploop + Для работы OpenVZ с файлами контейнера, существует два метода: -* SimFS (каталоги и файлы в файловой системе хост-ноды) -* ploop (отдельный файл для каждого контейнера) + +- SimFS (каталоги и файлы в файловой системе хост-ноды) +- ploop (отдельный файл для каждого контейнера) По умолчанию в OpenVZ используется ploop. SimFS уже давно не используется, и с версии OpenVZ 7 больше не будет поддерживаться. Основные преимущества ploop: -* поддержка корректной и надежной изоляции пользователей друг от друга -* журнал файловой системы больше не является узким местом -* живая миграция -* поддержка различных типов хранения данных -* быстрое изменение размера контейнера без его отключения + +- поддержка корректной и надежной изоляции пользователей друг от друга +- журнал файловой системы больше не является узким местом +- живая миграция +- поддержка различных типов хранения данных +- быстрое изменение размера контейнера без его отключения ploop может работать только с файловой системой ext4. Для тех, кому требуется использование устаревшего SimFS существует возможность его включения: + ``` [root@vz ~]# vim /etc/vz/vz.conf #VEFSTYPE="ext4" @@ -1407,24 +1572,29 @@ bin/ dev/ home/ lib64/ mnt/ proc/ run/ srv/ tmp/ var/ Для отключения SimFS нужно в файле `/etc/vz/vz.conf` установить переменную `VEFSTYPE="ext4"`. ## [⬆](#toc) <a name='snapshots'></a>Управление снапшотами + Перед созданием снапшота рекомендуется закончить установку ПО, загрузку файлов и запись на внешние устройства. Также рекомендуется отменить транзакции во внешние БД. Создание снапшота контейнера: + ``` [root@vz ~]# prlctl snapshot ct2 -n FreshCentOS7 -d "Fresh CentOS 7 container" Creating the snapshot... The snapshot with id {aa9649d9-9ed1-408a-9463-36ce0cea6ba7} has been successfully created. ``` + где параметр `-n` указываем имя снапшота, `-d` – его описание, описание снапшота всегда указывается в кавычках. Снапшоты сохраняются в каталог `/vz/private/$UUID/dump/`: + ``` [root@vz ~]# ls /vz/private/49465252-b780-45f1-9784-538166be2367/dump/ {aa9649d9-9ed1-408a-9463-36ce0cea6ba7} {aa9649d9-9ed1-408a-9463-36ce0cea6ba7}.ve.conf ``` Подробная информация о снапшоте: + ``` [root@vz ~]# prlctl snapshot-list ct2 -i {aa9649d9-9ed1-408a-9463-36ce0cea6ba7} ID: {aa9649d9-9ed1-408a-9463-36ce0cea6ba7} @@ -1435,6 +1605,7 @@ Description: Fresh CentOS 7 container ``` Список доступных снапшотов для контейнера: + ``` [root@vz ~]# prlctl snapshot-list ct2 PARENT_SNAPSHOT_ID SNAPSHOT_ID @@ -1443,12 +1614,14 @@ PARENT_SNAPSHOT_ID SNAPSHOT_ID ``` Символ `*` указывает текущую ветку снапшота: + ``` [root@vz ~]# prlctl snapshot-list ct2 -t _{aa9649d9-9ed1-408a-9463-36ce0cea6ba7}*{e76f0a0d-aa8e-491f-a720-daa65dfb911a} ``` Для проверки работы снапшота создадим файл, а потом восстановимся из снапшота, в котором этого файла нет: + ``` [root@vz ~]# prlctl exec ct2 touch /root/file.txt [root@vz ~]# prlctl exec ct2 ls /root/file.txt @@ -1461,6 +1634,7 @@ ls: cannot access /root/file.txt: No such file or directory ``` Удаление снапшота: + ``` [root@vz ~]# prlctl snapshot-delete ct2 --id {aa9649d9-9ed1-408a-9463-36ce0cea6ba7} Delete the snapshot... @@ -1470,11 +1644,14 @@ The snapshot has been successfully deleted. При удалении родительского снапшота, снапшоты-потомки не удаляются. ## [⬆](#toc) <a name='vm'></a>Работа с виртуальными машинами + Помимо создания контейнеров, OpenVZ 7 поддерживает создание и управление виртуальными машинами на базе QEMU/KVM. Утилита `prlctl` имеет возможность создавать и управлять виртуальными машинами, помимо этого также доступно управление с помощью `libvirt`. ### <a name='create-vm'></a>Создание и запуск ВМ + Создание виртуальной машины практически ничем не отличается от создания контейнера: + ``` [root@vz ~]# prlctl create vm1 --distribution rhel7 --vmtype vm Creating the virtual machine... @@ -1484,40 +1661,45 @@ The VM has been successfully created. Ключ `--distribution` (`-d`) указывает на семейство ОС или дистрибутив для оптимизации виртуального окружения. Список всех официально поддерживаемых ОС: + ``` [root@vz ~]# prlctl create vm1 -d list The following values are allowed: -win-2000 win-xp win-2003 win-vista -win-2008 win-7 win-8 win-2012 -win-8.1 win rhel rhel7 -suse debian fedora-core fc -xandros ubuntu mandriva centos -centos7 vzlinux7 psbm redhat -opensuse linux-2.4 linux-2.6 linux -mageia mint freebsd-4 freebsd-5 -freebsd-6 freebsd-7 freebsd-8 freebsd -chrome-1 chrome +win-2000 win-xp win-2003 win-vista +win-2008 win-7 win-8 win-2012 +win-8.1 win rhel rhel7 +suse debian fedora-core fc +xandros ubuntu mandriva centos +centos7 vzlinux7 psbm redhat +opensuse linux-2.4 linux-2.6 linux +mageia mint freebsd-4 freebsd-5 +freebsd-6 freebsd-7 freebsd-8 freebsd +chrome-1 chrome ``` Для каждой виртуальной машины в каталоге `/vz/vmprivate/` создается собственная директория с именем, соответствующим ее UUID: + ``` [root@vz ~]# ls /vz/vmprivate/1bdb465a-31e6-46c5-ad7b-947f6ff00208/ config.pvs config.pvs.backup harddisk.hdd ``` Для каждой ВМ имеется как минимум два файла: -* файл конфигурации `config.pvs` -* виртуальный жесткий диск `harddisk.hdd` + +- файл конфигурации `config.pvs` +- виртуальный жесткий диск `harddisk.hdd` В файле конфигурации описываются параметры виртуальной машины в XML-формате. В свою очередь виртуальный жесткий диск может быть двух типов: -* plain — диск с фиксированным размером -* expanded — диск с изменяемым размером + +- plain — диск с фиксированным размером +- expanded — диск с изменяемым размером По умолчанию при создании виртуальной машины, создается expanded-диск размером 65G. Просмотр только что созданной ВМ: + ``` [root@vz ~]# prlctl list -a UUID STATUS IP_ADDR T NAME @@ -1527,6 +1709,7 @@ UUID STATUS IP_ADDR T NAME ``` По аналогии с контейнерами установим необходимые параметры для виртуальной машины: + ``` [root@vz ~]# prlctl set vm1 --description "Backend for app" [root@vz ~]# prlctl set vm1 --device-set net0 --ipadd 192.168.0.180/24 @@ -1550,12 +1733,14 @@ UUID STATUS IP_ADDR T NAME ``` Ключ `--autostart` аналогичен `--onboot` для контейнеров, который указывает возможность автостарта контейнера при старте хост-ноды: + ``` [root@vz ~]# prlctl set vm1 --autostart on ``` Параметры виртуальной машины установлены, ее можно запускать, однако для установки гостевой ОС необходим соответствующий образ. Для хранения образов ОС можно создать отдельный каталог и централизованно хранить в нем все образы: + ``` [root@vz ~]# mkdir /vz/vmprivate/images/ [root@vz ~]# ls /vz/vmprivate/images/ -1 @@ -1563,19 +1748,22 @@ CentOS-7-x86_64-Minimal-1503-01.iso 9200.16384.WIN8_RTM.120725-1247_X64FRE_SERVER_EVAL_RU-RU-HRM_SSS_X64FREE_RU-RU_DV5.ISO ``` -Ознакомительные образы Windows Server можно найти по адресу: https://www.microsoft.com/ru-ru/evalcenter/evaluate-windows-server-2016 +Ознакомительные образы Windows Server можно найти по адресу: <https://www.microsoft.com/ru-ru/evalcenter/evaluate-windows-server-2016> Установка ВМ с образа `CentOS-7-x86_64-Minimal-1503-01.iso`: + ``` [root@vz ~]# prlctl set vm1 --device-set cdrom1 --image "/vz/vmprivate/images/CentOS-7-x86_64-Minimal-1503-01.iso" --iface scsi --position 1 ``` Изменение размера диска до 8G: + ``` [root@vz ~]# prl_disk_tool resize --hdd /vz/vmprivate/vm1.pvm/harddisk.hdd --size 8G ``` Просмотр конфигурации виртуальной машины перед запуском: + ``` [root@vz ~]# prlctl list vm1 -i | grep Hardware -A9 Hardware: @@ -1591,7 +1779,9 @@ Hardware: ``` ### <a name='vnc'></a>VNC + Подключение VNC для ВМ: + ``` [root@vz ~]# prlctl set vm1 --vnc-mode manual --vnc-port 5901 --vnc-passwd Oiwaiqud Configure VNC: Remote display: mode=manual port=5901 @@ -1603,11 +1793,13 @@ Configure VNC: Remote display: mode=manual port=5901 По аналогии с виртуальными машинами, VNC доступен и для контейнеров. Запуск виртуальной машины: + ``` [root@vz ~]# prlctl start vm1 ``` Теперь к ВМ можно подключиться по VNC: + ``` user@localhost ~ $ sudo apt-get install xvnc4viewer user@localhost ~ $ xvnc4viewer 192.168.0.150:5901 @@ -1624,6 +1816,7 @@ Password: Oiwaiqud  После установки ОС, можно соединиться к виртуальной машине по SSH: + ``` user@localhost ~ $ ssh root@192.168.0.180 root@192.168.0.180's password: eihaixahghath7A @@ -1631,12 +1824,15 @@ root@192.168.0.180's password: eihaixahghath7A ``` ### <a name='guest-tools'></a>Дополнения гостевой ОС + OpenVZ поддерживает OpenVZ Guest Tools (дополнения гостевой ОС), которые позволяют выполнять некоторые операции в ВМ такие как: -* запуск команд в ВМ с помощью `prlctl exec` -* установка паролей для пользователей с помощью `prlctl set --userpasswd` -* управление сетевыми настройками в ВМ + +- запуск команд в ВМ с помощью `prlctl exec` +- установка паролей для пользователей с помощью `prlctl set --userpasswd` +- управление сетевыми настройками в ВМ Установка дополнений для `vm1` с хост-ноды: + ``` [root@vz ~]# prlctl installtools vm1 Installing... @@ -1644,6 +1840,7 @@ The Parallels tools have been successfully installed. ``` Далее необходимо войти в ВМ, например по SSH и запустить скрипт установки дополнений: + ``` [root@vz ~]# ssh root@192.168.0.180 root@192.168.0.180's password: eihaixahghath7A @@ -1663,6 +1860,7 @@ Done! ``` Проверка корректности установки дополнений с хост-ноды: + ``` [root@vz ~]# prlctl exec vm1 uname -a Linux vm1.tld 3.10.0-229.el7.x86_64 #1 SMP Fri Mar 6 11:36:42 UTC 2015 x86_64 x86_64 x86_64 GNU/Linux @@ -1673,37 +1871,42 @@ uid=1000(testuser) gid=1000(testuser) groups=1000(testuser) ``` В гостевой Windows установка дополнений сводится к трем пунктам: -* установка драйвера, который находится в `<CD_root>/vioserial/<Win_version>/amd64/vioser.inf` -* запуск `prl_nettool_<Win_arch>.msi` и `qemu-ga-<Win_arch>.msi` -* проверка работоспособности сервиса `qemu-ga.exe` + +- установка драйвера, который находится в `<CD_root>/vioserial/<Win_version>/amd64/vioser.inf` +- запуск `prl_nettool_<Win_arch>.msi` и `qemu-ga-<Win_arch>.msi` +- проверка работоспособности сервиса `qemu-ga.exe` Автоматическое обновление дополнений гостевой ОС в ВМ: + ``` [root@vz ~]# prlctl set vm1 --tools-autoupdate on ``` ### <a name='pause-vm'></a>Приостановка виртуальных машин + Команды управления контейнерами с помощью `prlctl` аналогично используются и для ВМ: -* `set` -* `list` -* `start` -* `stop` -* `restart` -* `suspend` -* `resume` -* `exec` -* `enter` -* `console` -* `status` -* `create` -* `delete` -* `mount` -* `umount` -* `clone` -* `move` -* `snapshot` + +- `set` +- `list` +- `start` +- `stop` +- `restart` +- `suspend` +- `resume` +- `exec` +- `enter` +- `console` +- `status` +- `create` +- `delete` +- `mount` +- `umount` +- `clone` +- `move` +- `snapshot` Вдобавок к этим командам существует возможность приостанавливать ВМ: + ``` [root@vz ~]# prlctl pause vm1 Pause the VM... @@ -1714,9 +1917,11 @@ VM vm1 exist paused ``` ### <a name='templates-vm'></a>Шаблоны конфигураций + На основе уже имеющихся виртуальных машин можно создавать типовые конфигурации. Пример создания шаблона `config-1024MB-centos7`, основанный на ранее настроенной `vm1`: + ``` [root@vz ~]# mkdir /etc/parallels/samples [root@vz ~]# cp /vz/vmprivate/vm1.pvm/config.pvs /etc/parallels/samples/config-1024MB-centos7.pvs @@ -1739,14 +1944,17 @@ Boot order: hdd0 cdrom0 ``` ### <a name='devices-vm'></a>Добавление и удаление устройств в ВМ + Для каждой виртуальной машины доступно максимальное количество устройств: -* 4 IDE или 8 SCSI (HDD, CD/DVD-ROM) устройств -* 16 сетевых адаптеров -* 4 последовательных (COM) порта -* один USB-контроллер -* одно FDD устройство + +- 4 IDE или 8 SCSI (HDD, CD/DVD-ROM) устройств +- 16 сетевых адаптеров +- 4 последовательных (COM) порта +- один USB-контроллер +- одно FDD устройство Добавление дополнительного HDD для виртуальной машины с Linux: + ``` [root@vz ~]# prlctl list vm1 -i | grep hdd Boot order: hdd0 cdrom1 @@ -1761,6 +1969,7 @@ Boot order: hdd0 cdrom1 hdd1 ``` После того как диск добавлен, нужно создать на нем раздел и отформатировать его: + ``` [root@vz ~]# prlctl enter vm1 [root@vm1 /]# lsblk | grep sd @@ -1784,6 +1993,7 @@ Command (m for help): w ``` С помощью ключа `--device-disconnect` можно отключить устройство от ВМ: + ``` [root@vz ~]# prlctl set vm1 --device-disconnect cdrom1 Disconnect device: cdrom1 @@ -1796,6 +2006,7 @@ Boot order: hdd0 cdrom1 hdd1 Включить устройство можно воспользовавшись ключом `--device-connect`. Чтобы полностью удалить устройство, нужно использовать ключ `--device-del`: + ``` [root@vz ~]# prlctl set vm1 --device-del usb Remove the usb device. @@ -1807,6 +2018,7 @@ Remove the cdrom1 device. При удалении HDD из виртуальной машины можно сохранить сам виртуальный диск, для этого используется ключ `--detach-only`, по умолчанию диск удаляется, что является умолчанием ключа `--destroy-image`. Изменение приоритета загрузки устройств: + ``` [root@vz ~]# prlctl list vm1 -i | grep "Boot order" Boot order: hdd0 hdd1 @@ -1816,6 +2028,7 @@ Boot order: hdd1 hdd0 ``` Пример добавления дополнительного сетевого устройства: + ``` [root@vz ~]# prlctl set vm1 --device-add net --network Bridged --mac auto --ipadd 192.168.0.181 --gw 192.168.122.1 --nameserver 192.168.0.1 --adapter-type virtio Enable automatic reconfiguration for this network adapter. @@ -1827,11 +2040,13 @@ Created net1 (+) dev='vme42afdc9b' network='Bridged' mac=001C42AFDC9B card=virti ``` ### <a name='hotplug-vm'></a>Горячее подключение CPU и RAM + Для виртуальных машин доступно горячее подключение (hotplug) ресурсов без перезагрузки самих виртуальных машин. К таким ресурсам относятся оперативная память и процессор. По умолчанию для виртуальных машин горячее подключение отключено. Для добавления оперативной памяти "налету" необходимо установить значение ключа `--mem-hotplug` в `on`: + ``` [root@vz ~]# prlctl list vm1 -i | grep "memory " memory 1024Mb @@ -1840,6 +2055,7 @@ set mem hotplug: 1 ``` После установки параметра нужно единожды перезагрузить виртуальную машину и затем изменять количество памяти: + ``` [root@vz ~]# prlctl restart vm1 [root@vz ~]# prlctl set vm1 --memsize 1536M @@ -1850,10 +2066,12 @@ Set the memsize parameter to 1536Mb. Для включения CPU hotplug, необходимо чтобы операционная система гостевой ВМ поддерживала данную функцию. На данный момент поддерживаются: -* дистрибутивы основанные на RHEL 5 и выше -* Windows Server 2008 x64 и выше + +- дистрибутивы основанные на RHEL 5 и выше +- Windows Server 2008 x64 и выше Включение CPU hotplug происходит по аналогии с MEM hotplug: + ``` [root@vz ~]# prlctl list vm1 -i | grep cpu cpu cpus=2 VT-x accl=high mode=32 cpuunits=1000 cpulimit=1024Mhz ioprio=6 iolimit='0' mask=0-1 @@ -1862,6 +2080,7 @@ Set the memsize parameter to 1536Mb. ``` Перезагрузка виртуальной машины и проверка ресурсов: + ``` [root@vz ~]# prlctl restart vm1 [root@vz ~]# prlctl set vm1 --cpuunits 2000 --cpus 3 --cpumask 0-2 @@ -1875,6 +2094,7 @@ set cpu mask 0-2 Для отключения hotplug используется значения ключей `--mem-hotplug off` и `--cpu-hotplug off` соответственно. ### <a name='ksm'></a>Оптимизация виртуальных машин с помощью KSM + KSM (Kernel Same-Page Merging) — технология ядра Linux, которая позволяет ядру объединять одинаковые страницы памяти между различными процессами или виртуальными гостевыми системами в одну для совместного использования. Технология предусматривает сканирование памяти в целях поиска дубликатов страниц, каждая пара дубликатов объединяется в одну страницу, помечаемую как подлежащую копированию при записи, таким образом ядро будет автоматически разделять страницы памяти, как только один процесс изменит данные. @@ -1884,35 +2104,41 @@ KSM обеспечивает системам виртуализации воз� В условиях достаточно однородных экземпляров гостевых операционных систем возможен значительный эффект, в частности, экспериментальная реализация KSM от Red Hat показала, что 52 виртуальных экземпляра Windows XP с выделенными 1GB памяти, могут работать на хост-ноде с 16GB оперативной памяти. Для включения KSM в OpenVZ необходимо запустить сервисы `ksm` и `ksmtuned`: + ``` [root@vz ~]# systemctl start ksm ksmtuned [root@vz ~]# systemctl enable ksm ksmtuned ``` Работоспособность KSM можно проверить на примере общих страниц в памяти (shared memory pages): + ``` [root@vz ~]# cat /sys/kernel/mm/ksm/pages_sharing 120990 ``` ## [⬆](#toc) <a name='migration'></a>Миграция контейнеров и виртуальных машин + В OpenVZ поддерживается "живая" миграция контейнеров и виртуальных машин с использованием CRIU и P.Haul. Пример миграции контейнера `ct3` с хост-ноды `vz-source` на `vz-dest` (192.168.0.190). Создаем и копируем SSH-ключ с `vz-source` на `vz-dest` для беспарольной аутентификации: + ``` [root@vz-source ~]# ssh-keygen [root@vz-source ~]# ssh-copy-id root@192.168.0.190 ``` Запускаем миграцию в `screen`: + ``` [root@vz-source ~]# screen -S migrate-dest [root@vz-source ~]# prlctl migrate ct3 192.168.0.190 ``` Проверка на `vz-dest` смигрированного контейнера: + ``` [root@vz-dest ~]# prlctl list ct3 UUID STATUS IP_ADDR T NAME @@ -1920,7 +2146,9 @@ UUID STATUS IP_ADDR T NAME ``` ## [⬆](#toc) <a name='extra-info'></a>Расширенная информация о контейнерах и ВМ + Подробную информацию о контейнере или виртуальной машине можно получить с помощью параметра `list` с ключом `-i` (`--info`): + ``` [root@vz ~]# prlctl list -i ct4 INFO @@ -1970,6 +2198,7 @@ Search Domains: 192.168.0.1 ``` Существует также возможность просмотра дополнительной информации о контейнерах: + ``` [root@vz ~]# prlctl list -o type,status,name,hostname,dist,ip T STATUS NAME HOSTNAME DIST IP_ADDR @@ -1979,6 +2208,7 @@ VM stopped vm1 vm1.vz.localhost rhel7 192.168.0.163 FE80:0: ``` Список всех доступных полей: + ``` [root@vz ~]# prlctl list -L uuid UUID @@ -2006,47 +2236,52 @@ ha_prio HA_PRIO ``` ## [⬆](#toc) <a name='recommendations'></a>Рекомендации системному администратору -* если работа хост-ноды замедлилась, для анализа нагрузки можно воспользоваться утилитами `vzps`, `vztop`, `iotop`, `atop` -* для обнаружения сетевых проблем можно воспользоваться утилитами `ping`, `traceroute`, `nmap`, `mtr`, `tcpdump`, `nc`, `iftop`, `netstat`, `ss` -* `strace` будет верным помощником для отслеживания системных вызовов -* используйте RAID для обеспечения сохранности данных -* для экстренных ситуаций, когда могут быть проблемы с сетью необходимо всегда иметь под рукой IPMI или KVM-доступ -* не перезагружайте хост-ноду без выяснения обстоятельств неполадок, делайте это только в самых крайних случаях -* следите за временем на сервере, используйте для синхронизации NTP на хост-ноде -* в контейнерах нет смысла устанавливать второй экземпляр NTP, достаточно только указать нужный часовой пояс -* не запускайте блобы или скрипты, которые принадлежат VPS, непосредственно с хост-ноды -* для поиска руткитов можно воспользоваться утилитами `chrootkit` и `rkhunter` -* следите за нагрузкой сервера, обезопасьтесь от DoS/DDoS -* используйте системы конфигураций, такие как Puppet, Ansible, Chef, SaltStack, CFEngine если используется большое количество однотипных конфигураций на хост-нодах -* делайте резервные копии важных данных -* следите за свободным местом на жестких дисках, используйте ротацию логов -* следите за пулом IP-адресов, они могут закончиться в самый неподходящий момент -* проверяйте каталог `/var/log/`, который содержит логи системы -* используйте `iptables`, `fail2ban`, `ipset` -* генерируйте сложные для перебора пароли (например с помощью `pwgen`), периодически меняйте их, уведомляйте пользователей об этом -* внимательно работайте на сервере под учетной записью `root` -* следите за рассылками новостей по безопасности -* обновляйте ПО, систему и ее компоненты -* следите за правами пользователей, файлов и каталогов на сервере -* используйте системы мониторинга ресурсов (например Cacti, Munin, MRTG, Zabbix, Nagios, Icinga, Monit) -* ведите внутреннюю документацию по серверам и их настройке -* в случае обнаружения проблем, можно обратиться к документации проектов OpenVZ и Virtuozzo, а также задать вопросы на тематических форумах + +- если работа хост-ноды замедлилась, для анализа нагрузки можно воспользоваться утилитами `vzps`, `vztop`, `iotop`, `atop` +- для обнаружения сетевых проблем можно воспользоваться утилитами `ping`, `traceroute`, `nmap`, `mtr`, `tcpdump`, `nc`, `iftop`, `netstat`, `ss` +- `strace` будет верным помощником для отслеживания системных вызовов +- используйте RAID для обеспечения сохранности данных +- для экстренных ситуаций, когда могут быть проблемы с сетью необходимо всегда иметь под рукой IPMI или KVM-доступ +- не перезагружайте хост-ноду без выяснения обстоятельств неполадок, делайте это только в самых крайних случаях +- следите за временем на сервере, используйте для синхронизации NTP на хост-ноде +- в контейнерах нет смысла устанавливать второй экземпляр NTP, достаточно только указать нужный часовой пояс +- не запускайте блобы или скрипты, которые принадлежат VPS, непосредственно с хост-ноды +- для поиска руткитов можно воспользоваться утилитами `chrootkit` и `rkhunter` +- следите за нагрузкой сервера, обезопасьтесь от DoS/DDoS +- используйте системы конфигураций, такие как Puppet, Ansible, Chef, SaltStack, CFEngine если используется большое количество однотипных конфигураций на хост-нодах +- делайте резервные копии важных данных +- следите за свободным местом на жестких дисках, используйте ротацию логов +- следите за пулом IP-адресов, они могут закончиться в самый неподходящий момент +- проверяйте каталог `/var/log/`, который содержит логи системы +- используйте `iptables`, `fail2ban`, `ipset` +- генерируйте сложные для перебора пароли (например с помощью `pwgen`), периодически меняйте их, уведомляйте пользователей об этом +- внимательно работайте на сервере под учетной записью `root` +- следите за рассылками новостей по безопасности +- обновляйте ПО, систему и ее компоненты +- следите за правами пользователей, файлов и каталогов на сервере +- используйте системы мониторинга ресурсов (например Cacti, Munin, MRTG, Zabbix, Nagios, Icinga, Monit) +- ведите внутреннюю документацию по серверам и их настройке +- в случае обнаружения проблем, можно обратиться к документации проектов OpenVZ и Virtuozzo, а также задать вопросы на тематических форумах ## [⬆](#toc) <a name='links'></a>Ссылки -* https://docs.openvz.org -* https://src.openvz.org -* https://wiki.openvz.org -* https://lists.openvz.org -* https://bugs.openvz.org + +- <https://docs.openvz.org> +- <https://src.openvz.org> +- <https://wiki.openvz.org> +- <https://lists.openvz.org> +- <https://bugs.openvz.org> ## [⬆](#toc) <a name='todo'></a>TODO -* управление сетью (veth/vlan/shaping) -* проброс устройств (usb/vlan) (https://habrahabr.ru/post/210460/) -* некоторые ключи для `prlctl set`: `--3d-accelerate` `--vertical-sync` `--memguarantee` `--autostop` `--start-as-user` `--autostart-delay` `--autostop` `--autocompact` -* создание шаблона гостевой ОС на основе vztt/vzmktmpl + +- управление сетью (veth/vlan/shaping) +- проброс устройств (usb/vlan) (<https://habrahabr.ru/post/210460/)> +- некоторые ключи для `prlctl set`: `--3d-accelerate` `--vertical-sync` `--memguarantee` `--autostop` `--start-as-user` `--autostart-delay` `--autostop` `--autocompact` +- создание шаблона гостевой ОС на основе vztt/vzmktmpl ## [⬆](#toc) <a name='license'></a>Лицензия + [](https://creativecommons.org/licenses/by-sa/4.0/deed.ru) ## [⬆](#toc) <a name='repo'></a>Репозиторий проекта + [](https://github.com/Amet13/vz-tutorial) |